| (10 intermediate revisions by 3 users not shown) | |||

| Line 1: | Line 1: | ||

| − | = | + | =1 Introducción= |

| − | + | En optimización, la estrategia de búsqueda en línea es uno de los enfoques iterativos básicos para encontrar un mínimo local <math display="inline">\displaystyle v^{*}</math> de una función objetivo <math display="inline">\displaystyle f:\mathbb {R} ^{n}\to \mathbb {R}</math>. El enfoque de búsqueda en línea primero supone conocida una aproximación previa <math display="inline">u</math> para <math display="inline">v^*</math> y encuentra una dirección de descenso <math display="inline">w</math> a lo largo de la cual la función objetivo <math display="inline">\displaystyle f</math> será minimizada y entonces esto determinará qué tan lejos <math display="inline">u</math> debe moverse a lo largo de esa dirección. Este tamaño de paso está asociado con un mínimo local de la restricción de <math display="inline">f</math> a la recta de búsqueda. Al problema de encontrar este tamaño de paso se le llama un problema de búsqueda en línea, es decir, es un problema de minimización con restricciones de la forma | |

| − | |||

| − | |||

| − | |||

| − | |||

| − | |||

| − | |||

| − | |||

| − | |||

| − | |||

| − | |||

{| class="formulaSCP" style="width: 100%; text-align: left;" | {| class="formulaSCP" style="width: 100%; text-align: left;" | ||

|- | |- | ||

| Line 21: | Line 11: | ||

| style="text-align: center;" | <math>\left\{\begin{array}{c}Min\hbox{ }f(v) \\ \hbox{sujeto a } v =u -\rho w , \forall \rho \in \mathbb{R};u ,w \in \mathbb{R}^{n} ,\end{array}\right. </math> | | style="text-align: center;" | <math>\left\{\begin{array}{c}Min\hbox{ }f(v) \\ \hbox{sujeto a } v =u -\rho w , \forall \rho \in \mathbb{R};u ,w \in \mathbb{R}^{n} ,\end{array}\right. </math> | ||

|} | |} | ||

| − | + | ||

|} | |} | ||

que también se puede escribir como | que también se puede escribir como | ||

| − | <span id="eq- | + | <span id="eq-1"></span> |

{| class="formulaSCP" style="width: 100%; text-align: left;" | {| class="formulaSCP" style="width: 100%; text-align: left;" | ||

|- | |- | ||

| Line 34: | Line 24: | ||

| style="text-align: center;" | <math>Min_{\rho \in \mathbb{R}}\hbox{ }f(u -\rho w) . </math> | | style="text-align: center;" | <math>Min_{\rho \in \mathbb{R}}\hbox{ }f(u -\rho w) . </math> | ||

|} | |} | ||

| − | | style="width: 5px;text-align: right;white-space: nowrap;" | ( | + | | style="width: 5px;text-align: right;white-space: nowrap;" | (1) |

|} | |} | ||

| − | Aquí la recta de búsqueda es la recta que pasa por <math display="inline">u</math> y tiene (por conveniencia, para nuestras posteriores aplicaciones) la dirección <math display="inline">-w</math>. Como ya se dijo, una de las áreas donde surgen problemas de búsqueda en línea son los métodos iterativos para minimizar localmente una función <math display="inline">f :\mathbb{R}^{n} \rightarrow \mathbb{R}</math> sin restricciones. En cada iteración <math display="inline">i</math> debe resolverse un problema de búsqueda en línea de la forma ([[#eq- | + | Aquí la recta de búsqueda es la recta que pasa por <math display="inline">u</math> y tiene (por conveniencia, para nuestras posteriores aplicaciones) la dirección <math display="inline">-w</math>. Como ya se dijo, una de las áreas donde surgen problemas de búsqueda en línea son los métodos iterativos para minimizar localmente una función <math display="inline">f :\mathbb{R}^{n} \rightarrow \mathbb{R}</math> sin restricciones. En cada iteración <math display="inline">i</math> debe resolverse un problema de búsqueda en línea de la forma ([[#eq-1|1]]), para <math display="inline">u</math> y <math display="inline">w</math> conocidos. Si denotamos con <math display="inline">\rho _{i}</math> a la solución del problema de búsqueda en línea de la iteración <math display="inline">i</math>, se toma a <math display="inline">v_{i} =u -\rho _{i}w</math> como la nueva aproximación para el mínimo de <math display="inline">f</math>. La solución de los problemas de búsqueda en línea se puede aproximar por una variedad de métodos numéricos <span id='citeF-1'></span>[[#cite-1|[1]]], entre ellos el método de Newton. Si definimos <math display="inline">g(\rho )=f(u -\rho w)</math> entonces la solución del problema ([[#eq-1|1]]) es equivalente a la solución del problema en <math display="inline">\mathbb{R}</math> |

| + | |||

| − | |||

{| class="formulaSCP" style="width: 100%; text-align: left;" | {| class="formulaSCP" style="width: 100%; text-align: left;" | ||

|- | |- | ||

| Line 47: | Line 37: | ||

| style="text-align: center;" | <math>Min_{\rho \in \mathbb{R}}\hbox{ }g(\rho ) . </math> | | style="text-align: center;" | <math>Min_{\rho \in \mathbb{R}}\hbox{ }g(\rho ) . </math> | ||

|} | |} | ||

| − | + | ||

|} | |} | ||

Para resolver este problema buscamos los valores donde la derivada de <math display="inline">g</math> se hace cero, es decir, resolvemos (por el método de Newton) la ecuación | Para resolver este problema buscamos los valores donde la derivada de <math display="inline">g</math> se hace cero, es decir, resolvemos (por el método de Newton) la ecuación | ||

| − | + | ||

{| class="formulaSCP" style="width: 100%; text-align: left;" | {| class="formulaSCP" style="width: 100%; text-align: left;" | ||

|- | |- | ||

| Line 60: | Line 50: | ||

| style="text-align: center;" | <math>g'(\rho ^{*})=0 . </math> | | style="text-align: center;" | <math>g'(\rho ^{*})=0 . </math> | ||

|} | |} | ||

| − | + | ||

|} | |} | ||

Tenemos que | Tenemos que | ||

| − | + | ||

{| class="formulaSCP" style="width: 100%; text-align: left;" | {| class="formulaSCP" style="width: 100%; text-align: left;" | ||

|- | |- | ||

| Line 73: | Line 63: | ||

| style="text-align: center;" | <math>g'(\rho )=-Df(u-\rho w;w)=-\nabla f(u-\rho w)\cdot w , </math> | | style="text-align: center;" | <math>g'(\rho )=-Df(u-\rho w;w)=-\nabla f(u-\rho w)\cdot w , </math> | ||

|} | |} | ||

| − | + | ||

|} | |} | ||

donde <math display="inline">Df(v;w)</math> denota la derivada direccional de <math display="inline">f</math> en <math display="inline">v</math> en la dirección de <math display="inline">w</math>. Así que por comodidad definimos | donde <math display="inline">Df(v;w)</math> denota la derivada direccional de <math display="inline">f</math> en <math display="inline">v</math> en la dirección de <math display="inline">w</math>. Así que por comodidad definimos | ||

| − | + | ||

{| class="formulaSCP" style="width: 100%; text-align: left;" | {| class="formulaSCP" style="width: 100%; text-align: left;" | ||

|- | |- | ||

| Line 86: | Line 76: | ||

| style="text-align: center;" | <math>H(\rho )=-g'(\rho )=Df(u-\rho w;w)=\nabla f(u-\rho w)\cdot w </math> | | style="text-align: center;" | <math>H(\rho )=-g'(\rho )=Df(u-\rho w;w)=\nabla f(u-\rho w)\cdot w </math> | ||

|} | |} | ||

| − | + | ||

|} | |} | ||

y resolvemos la ecuación | y resolvemos la ecuación | ||

| − | + | ||

{| class="formulaSCP" style="width: 100%; text-align: left;" | {| class="formulaSCP" style="width: 100%; text-align: left;" | ||

|- | |- | ||

| Line 99: | Line 89: | ||

| style="text-align: center;" | <math>H(\rho ^{*})=0, </math> | | style="text-align: center;" | <math>H(\rho ^{*})=0, </math> | ||

|} | |} | ||

| − | + | ||

|} | |} | ||

| Line 111: | Line 101: | ||

| style="text-align: center;" | <math>\rho _{i +1} =\rho _{i} -\frac{H(\rho _{i})}{H^{ \prime }(\rho _{i})} ,i =0 ,1 ,2 , . . . . </math> | | style="text-align: center;" | <math>\rho _{i +1} =\rho _{i} -\frac{H(\rho _{i})}{H^{ \prime }(\rho _{i})} ,i =0 ,1 ,2 , . . . . </math> | ||

|} | |} | ||

| − | + | ||

|} | |} | ||

En este trabajo extenderemos estas ideas para aplicar el método de Newton a un problema de búsqueda en línea pero donde los elementos <math display="inline">u</math> y <math display="inline">w</math> aunque conocidos, pertenecen al espacio de Hilbert <math display="inline">(L^{2})^3</math> y no a <math display="inline">\mathbb {R} ^{n}</math>. En este contexto, este artículo es una continuación o extensión de lo expuesto en <span id='citeF-2'></span>[[#cite-2|[2]]]. | En este trabajo extenderemos estas ideas para aplicar el método de Newton a un problema de búsqueda en línea pero donde los elementos <math display="inline">u</math> y <math display="inline">w</math> aunque conocidos, pertenecen al espacio de Hilbert <math display="inline">(L^{2})^3</math> y no a <math display="inline">\mathbb {R} ^{n}</math>. En este contexto, este artículo es una continuación o extensión de lo expuesto en <span id='citeF-2'></span>[[#cite-2|[2]]]. | ||

| − | + | =2 Descripción del problema= | |

Los problemas de búsqueda en línea en que estamos interesados aquí son del tipo | Los problemas de búsqueda en línea en que estamos interesados aquí son del tipo | ||

| − | <span id="eq- | + | <span id="eq-2"></span> |

{| class="formulaSCP" style="width: 100%; text-align: left;" | {| class="formulaSCP" style="width: 100%; text-align: left;" | ||

|- | |- | ||

| Line 128: | Line 118: | ||

| style="text-align: center;" | <math>\left\{ \begin{array}{c}\hbox{Encontrar }\mathbf{\rho ^*}\in \mathbb{R},\hbox{ tal que } \\ J(\mathbf{u}-\rho ^* \mathbf{w})\leq J(\mathbf{u}-\rho \mathbf{w}),\forall \rho \in \mathbb{R},\end{array}\right. </math> | | style="text-align: center;" | <math>\left\{ \begin{array}{c}\hbox{Encontrar }\mathbf{\rho ^*}\in \mathbb{R},\hbox{ tal que } \\ J(\mathbf{u}-\rho ^* \mathbf{w})\leq J(\mathbf{u}-\rho \mathbf{w}),\forall \rho \in \mathbb{R},\end{array}\right. </math> | ||

|} | |} | ||

| − | | style="width: 5px;text-align: right;white-space: nowrap;" | ( | + | | style="width: 5px;text-align: right;white-space: nowrap;" | (2) |

|} | |} | ||

con <math display="inline">\mathbf{u}</math> y <math display="inline">\mathbf{w}</math> fijos en <math display="inline">(L^{2} (0,T))^3</math>, y donde el funcional de nuestro interés <math display="inline">J:(L^{2} (0,T))^3 \longrightarrow \mathbb {R}</math> es | con <math display="inline">\mathbf{u}</math> y <math display="inline">\mathbf{w}</math> fijos en <math display="inline">(L^{2} (0,T))^3</math>, y donde el funcional de nuestro interés <math display="inline">J:(L^{2} (0,T))^3 \longrightarrow \mathbb {R}</math> es | ||

| − | <span id="eq- | + | <span id="eq-3"></span> |

{| class="formulaSCP" style="width: 100%; text-align: left;" | {| class="formulaSCP" style="width: 100%; text-align: left;" | ||

|- | |- | ||

| Line 141: | Line 131: | ||

| style="text-align: center;" | <math>J(\mathbf{v})=\frac{\eta }{2}\int \limits _{0}^{T}\Vert \mathbf{v} \Vert ^{2} dt+\frac{k}{2}||\mathbf{y}(T)-\mathbf{y}_{T}||^{2}, </math> | | style="text-align: center;" | <math>J(\mathbf{v})=\frac{\eta }{2}\int \limits _{0}^{T}\Vert \mathbf{v} \Vert ^{2} dt+\frac{k}{2}||\mathbf{y}(T)-\mathbf{y}_{T}||^{2}, </math> | ||

|} | |} | ||

| − | | style="width: 5px;text-align: right;white-space: nowrap;" | ( | + | | style="width: 5px;text-align: right;white-space: nowrap;" | (3) |

|} | |} | ||

donde <math display="inline">k,\eta >0</math> y <math display="inline">||.||</math> la norma euclideana canónica, donde <math display="inline">\mathbf{v}</math> es una función vectorial, <math display="inline">\mathbf{v}=(v_1(t),v_2(t), v_3(t))^T</math>, <math display="inline">\Vert \mathbf{v}\Vert ^2=v_1^2+v_2^2+v_3^2</math> y la función vectorial <math display="inline">\mathbf{y}=( y_{1},y_{2},y_{3})^T </math> es la solución del siguiente problema de valor inicial que modela la dinámica de un circuito de tres juntas de Josephson acopladas inductivamente, <span id='citeF-3'></span>[[#cite-3|[3]]]: | donde <math display="inline">k,\eta >0</math> y <math display="inline">||.||</math> la norma euclideana canónica, donde <math display="inline">\mathbf{v}</math> es una función vectorial, <math display="inline">\mathbf{v}=(v_1(t),v_2(t), v_3(t))^T</math>, <math display="inline">\Vert \mathbf{v}\Vert ^2=v_1^2+v_2^2+v_3^2</math> y la función vectorial <math display="inline">\mathbf{y}=( y_{1},y_{2},y_{3})^T </math> es la solución del siguiente problema de valor inicial que modela la dinámica de un circuito de tres juntas de Josephson acopladas inductivamente, <span id='citeF-3'></span>[[#cite-3|[3]]]: | ||

| − | <span id="eq- | + | <span id="eq-4"></span> |

{| class="formulaSCP" style="width: 100%; text-align: left;" | {| class="formulaSCP" style="width: 100%; text-align: left;" | ||

|- | |- | ||

| Line 154: | Line 144: | ||

| style="text-align: center;" | <math>\left\{ \begin{array}{c}\gamma _{1}\frac{dy_{1}}{dt}+\kappa _{1}(y_{1}-y_{2})+\sen y_{1}=i_{1}+v_{1},\hbox{ en }(0,T), \\ \gamma _{2}\frac{dy_{2}}{dt}+\kappa _{1}(y_{2}-y_{1})+\kappa _{2}(y_{2}-y_{3})+\sen y_{2}=i_{2}+v_{2},\hbox{ en }(0,T), \\ \gamma _{3}\frac{dy_{3}}{dt}+\kappa _{2}(y_{3}-y_{2})+\sen y_{3}=i_{3}+v_{3},\hbox{ en }(0,T), \\ \mathbf{y}(0)=\mathbf{y}_{0}.\end{array}\right. </math> | | style="text-align: center;" | <math>\left\{ \begin{array}{c}\gamma _{1}\frac{dy_{1}}{dt}+\kappa _{1}(y_{1}-y_{2})+\sen y_{1}=i_{1}+v_{1},\hbox{ en }(0,T), \\ \gamma _{2}\frac{dy_{2}}{dt}+\kappa _{1}(y_{2}-y_{1})+\kappa _{2}(y_{2}-y_{3})+\sen y_{2}=i_{2}+v_{2},\hbox{ en }(0,T), \\ \gamma _{3}\frac{dy_{3}}{dt}+\kappa _{2}(y_{3}-y_{2})+\sen y_{3}=i_{3}+v_{3},\hbox{ en }(0,T), \\ \mathbf{y}(0)=\mathbf{y}_{0}.\end{array}\right. </math> | ||

|} | |} | ||

| − | | style="width: 5px;text-align: right;white-space: nowrap;" | ( | + | | style="width: 5px;text-align: right;white-space: nowrap;" | (4) |

|} | |} | ||

| − | En ([[#eq- | + | En ([[#eq-3|3]])-([[#eq-4|4]]), <math display="inline">\mathbf{y}_{0}</math> y <math display="inline">\mathbf{y}_{T}</math> son estados inicial y final conocidos, respectivamente. En <span id='citeF-3'></span>[[#cite-3|[3]]] y en <span id='citeF-4'></span>[[#cite-4|[4]]] se dan los siguientes valores factibles para los parámetros involucrados en este sistema y con los cuales se harán los experimentos numéricos mas adelante: |

| + | |||

| − | |||

| − | |||

{| class="formulaSCP" style="width: 100%; text-align: left;" | {| class="formulaSCP" style="width: 100%; text-align: left;" | ||

|- | |- | ||

| Line 167: | Line 156: | ||

|- | |- | ||

| style="text-align: center;" | <math>\gamma _{1} =0.7,\hbox{ }\gamma _{2}=1.1,\hbox{ }\gamma _{3}=0.7,\hbox{ }i_{1}=1,\hbox{ }i_{2}=0.8,\hbox{ }i_{3}=-1, </math> | | style="text-align: center;" | <math>\gamma _{1} =0.7,\hbox{ }\gamma _{2}=1.1,\hbox{ }\gamma _{3}=0.7,\hbox{ }i_{1}=1,\hbox{ }i_{2}=0.8,\hbox{ }i_{3}=-1, </math> | ||

| − | + | ||

|- | |- | ||

| style="text-align: center;" | <math> \hbox{ }\kappa _{1} =\kappa _{2}=0.1. </math> | | style="text-align: center;" | <math> \hbox{ }\kappa _{1} =\kappa _{2}=0.1. </math> | ||

| − | + | ||

|} | |} | ||

|} | |} | ||

| − | + | ==2.1 El problema de minimización global y el diferencial de J== | |

El problema de minimización global o sin restricciones asociado con los problemas de búsqueda en línea descritos es | El problema de minimización global o sin restricciones asociado con los problemas de búsqueda en línea descritos es | ||

| − | + | ||

{| class="formulaSCP" style="width: 100%; text-align: left;" | {| class="formulaSCP" style="width: 100%; text-align: left;" | ||

|- | |- | ||

| Line 186: | Line 175: | ||

| style="text-align: center;" | <math>\left\{ \begin{array}{c}\hbox{Encontrar }v^{*}\in (L^{2}(0,T))^{3}, \hbox{tal que }\\ J(v^{*})\leq J(v),\forall v\in (L^{2}(0,T))^{3},\end{array}\right. </math> | | style="text-align: center;" | <math>\left\{ \begin{array}{c}\hbox{Encontrar }v^{*}\in (L^{2}(0,T))^{3}, \hbox{tal que }\\ J(v^{*})\leq J(v),\forall v\in (L^{2}(0,T))^{3},\end{array}\right. </math> | ||

|} | |} | ||

| − | + | ||

|} | |} | ||

| − | el cual, (junto con ([[#eq- | + | el cual, (junto con ([[#eq-3|3]])-([[#eq-4|4]])) corresponde a un problema de control cuyo objetivo es llevar la dinámica del sistema del estado <math display="inline">\mathbf{y}_{0}</math> al estado <math display="inline">\mathbf{y}_{T}</math>. Este tipo de problemas de control pueden resolverse usando un algoritmo de gradiente conjugado como los discutidos en el Capítulo 2 de <span id='citeF-5'></span>[[#cite-5|[5]]] y el Capítulo 3 de <span id='citeF-6'></span>[[#cite-6|[6]]], donde también se menciona el concepto de Frechet-diferenciabilidad adecuado para minimizar funcionales en espacios de Hilbert. A continuación damos una definción y un teorema básicos para resolver el problema que nos ocupa. |

Definición. Sea <math display="inline">V</math> un espacio de Hilbert. Un funcional <math display="inline">J</math> sobre <math display="inline">V</math> es Frechet-diferenciable si, para todo <math display="inline">v,w \in V</math>, existe <math display="inline">DJ(v) \in V'</math>, la derivada o el diferencial de <math display="inline">J</math> en <math display="inline">v</math>, tal que | Definición. Sea <math display="inline">V</math> un espacio de Hilbert. Un funcional <math display="inline">J</math> sobre <math display="inline">V</math> es Frechet-diferenciable si, para todo <math display="inline">v,w \in V</math>, existe <math display="inline">DJ(v) \in V'</math>, la derivada o el diferencial de <math display="inline">J</math> en <math display="inline">v</math>, tal que | ||

| − | + | ||

{| class="formulaSCP" style="width: 100%; text-align: left;" | {| class="formulaSCP" style="width: 100%; text-align: left;" | ||

|- | |- | ||

| Line 201: | Line 190: | ||

| style="text-align: center;" | <math>J(v+w)-J(v)=\langle DJ(v),w\rangle + \Vert w \Vert \epsilon (v,w), </math> | | style="text-align: center;" | <math>J(v+w)-J(v)=\langle DJ(v),w\rangle + \Vert w \Vert \epsilon (v,w), </math> | ||

|} | |} | ||

| − | + | ||

|} | |} | ||

con <math display="inline">\langle . , . \rangle </math> denotando par de dualidad, y <math display="inline">\epsilon (v,w)</math> tendiendo a cero cuando <math display="inline">\Vert w \Vert </math> tiende a cero. | con <math display="inline">\langle . , . \rangle </math> denotando par de dualidad, y <math display="inline">\epsilon (v,w)</math> tendiendo a cero cuando <math display="inline">\Vert w \Vert </math> tiende a cero. | ||

| − | Teorema. Si <math display="inline">J</math> está definido como en ([[#eq- | + | Teorema. Si <math display="inline">J</math> está definido como en ([[#eq-3|3]]) entonces es Frechet-diferenciable y su diferencial <math display="inline">DJ(\mathbf{v})</math> es |

| − | <span id="eq- | + | <span id="eq-5"></span> |

{| class="formulaSCP" style="width: 100%; text-align: left;" | {| class="formulaSCP" style="width: 100%; text-align: left;" | ||

|- | |- | ||

| Line 216: | Line 205: | ||

| style="text-align: center;" | <math>DJ(\mathbf{v})=\eta \mathbf{v}+\mathbf{p}, </math> | | style="text-align: center;" | <math>DJ(\mathbf{v})=\eta \mathbf{v}+\mathbf{p}, </math> | ||

|} | |} | ||

| − | | style="width: 5px;text-align: right;white-space: nowrap;" | ( | + | | style="width: 5px;text-align: right;white-space: nowrap;" | (5) |

|} | |} | ||

| − | donde <math display="inline">\mathbf{p}</math> se obtiene al resolver el sistema (versión matricial de ([[#eq- | + | donde <math display="inline">\mathbf{p}</math> se obtiene al resolver el sistema (versión matricial de ([[#eq-4|4]])) : |

| − | <span id="eq- | + | <span id="eq-6"></span> |

{| class="formulaSCP" style="width: 100%; text-align: left;" | {| class="formulaSCP" style="width: 100%; text-align: left;" | ||

|- | |- | ||

| Line 229: | Line 218: | ||

| style="text-align: center;" | <math>\left\lbrace \begin{array}{c}\Gamma \dfrac{d\mathbf{y}}{dt}+K\mathbf{y}+ \sen \mathbf{y}=\left( \begin{array}{ccc}i_1+v_1 \\ i_2+v_2 \\ i_3+v_3 \\ \end{array} \right)\hbox{ en } (0,T), \\ \mathbf{y}(0)=\mathbf{y}_0, \end{array} \right. </math> | | style="text-align: center;" | <math>\left\lbrace \begin{array}{c}\Gamma \dfrac{d\mathbf{y}}{dt}+K\mathbf{y}+ \sen \mathbf{y}=\left( \begin{array}{ccc}i_1+v_1 \\ i_2+v_2 \\ i_3+v_3 \\ \end{array} \right)\hbox{ en } (0,T), \\ \mathbf{y}(0)=\mathbf{y}_0, \end{array} \right. </math> | ||

|} | |} | ||

| − | | style="width: 5px;text-align: right;white-space: nowrap;" | ( | + | | style="width: 5px;text-align: right;white-space: nowrap;" | (6) |

|} | |} | ||

y después el sistema adjunto | y después el sistema adjunto | ||

| − | <span id="eq- | + | <span id="eq-7"></span> |

{| class="formulaSCP" style="width: 100%; text-align: left;" | {| class="formulaSCP" style="width: 100%; text-align: left;" | ||

|- | |- | ||

| Line 242: | Line 231: | ||

| style="text-align: center;" | <math>\left\lbrace \begin{array}{c}-\Gamma \dfrac{d\mathbf{p}}{dt}+K\mathbf{p}+ C(\mathbf{y}) \; \mathbf{p} =0 \hbox{ en } (0,T), \\ \Gamma \mathbf{p}(T)=k(\mathbf{y}(T)-\mathbf{y}_{T}), \end{array} \right. </math> | | style="text-align: center;" | <math>\left\lbrace \begin{array}{c}-\Gamma \dfrac{d\mathbf{p}}{dt}+K\mathbf{p}+ C(\mathbf{y}) \; \mathbf{p} =0 \hbox{ en } (0,T), \\ \Gamma \mathbf{p}(T)=k(\mathbf{y}(T)-\mathbf{y}_{T}), \end{array} \right. </math> | ||

|} | |} | ||

| − | | style="width: 5px;text-align: right;white-space: nowrap;" | ( | + | | style="width: 5px;text-align: right;white-space: nowrap;" | (7) |

|} | |} | ||

donde <math display="inline">C(\mathbf{y})</math> es una matriz diagonal de 3x3 para la cual la entrada iésima de la diagonal es <math display="inline">cos(y_i)</math>. | donde <math display="inline">C(\mathbf{y})</math> es una matriz diagonal de 3x3 para la cual la entrada iésima de la diagonal es <math display="inline">cos(y_i)</math>. | ||

| − | De este teorema resulta que <math display="inline">DJ(\mathbf{u}-\rho \mathbf{w})=\eta (\mathbf{u}-\rho \mathbf{w})+\mathbf{p}</math>, con <math display="inline">\mathbf{p}</math> solución de ([[#eq- | + | De este teorema resulta que <math display="inline">DJ(\mathbf{u}-\rho \mathbf{w})=\eta (\mathbf{u}-\rho \mathbf{w})+\mathbf{p}</math>, con <math display="inline">\mathbf{p}</math> solución de ([[#eq-7|7]]) una vez que <math display="inline">\mathbf{y}(t)</math> es solución del sistema ([[#eq-6|6]]) tomando <math display="inline">\mathbf{v}=\mathbf{u}-\rho \mathbf{w}</math>. |

La demostración de este teorema, y de los resultados que se mencionan a continuación pueden consultarse en <span id='citeF-7'></span>[[#cite-7|[7]]]. | La demostración de este teorema, y de los resultados que se mencionan a continuación pueden consultarse en <span id='citeF-7'></span>[[#cite-7|[7]]]. | ||

| − | + | =3 Metodología de solución= | |

| − | Para resolver por el método de Newton nuestro problema de búsqueda en línea ([[#eq- | + | Para resolver por el método de Newton nuestro problema de búsqueda en línea ([[#eq-2|2]]) definimos |

| − | <span id="eq- | + | <span id="eq-8"></span> |

{| class="formulaSCP" style="width: 100%; text-align: left;" | {| class="formulaSCP" style="width: 100%; text-align: left;" | ||

|- | |- | ||

| Line 263: | Line 252: | ||

| style="text-align: center;" | <math>g(\rho )=J(\mathbf{u}-\rho \mathbf{w}), </math> | | style="text-align: center;" | <math>g(\rho )=J(\mathbf{u}-\rho \mathbf{w}), </math> | ||

|} | |} | ||

| − | | style="width: 5px;text-align: right;white-space: nowrap;" | ( | + | | style="width: 5px;text-align: right;white-space: nowrap;" | (8) |

|} | |} | ||

| Line 272: | Line 261: | ||

para lo cual debemos conocer <math display="inline">g'</math> y <math display="inline">g''</math>. Para describir <math display="inline">g'(\rho )</math> en términos de <math display="inline">DJ</math> necesitamos el siguiente teorema: | para lo cual debemos conocer <math display="inline">g'</math> y <math display="inline">g''</math>. Para describir <math display="inline">g'(\rho )</math> en términos de <math display="inline">DJ</math> necesitamos el siguiente teorema: | ||

| − | '''Teorema.''' Sea <math display="inline">J</math> un funcional Frechet-diferenciable sobre <math display="inline">V</math> y <math display="inline">g</math> como en ([[#eq- | + | '''Teorema.''' Sea <math display="inline">J</math> un funcional Frechet-diferenciable sobre <math display="inline">V</math> y <math display="inline">g</math> como en ([[#eq-8|8]]). Entonces |

{| class="formulaSCP" style="width: 100%; text-align: left;" | {| class="formulaSCP" style="width: 100%; text-align: left;" | ||

| Line 281: | Line 270: | ||

| style="text-align: center;" | <math>g'(\rho )=\dfrac{d}{d\rho }J(\mathbf{u}-\rho \mathbf{w})=-\langle DJ (\mathbf{u}-\rho \mathbf{w}), \mathbf{w} \rangle{.} </math> | | style="text-align: center;" | <math>g'(\rho )=\dfrac{d}{d\rho }J(\mathbf{u}-\rho \mathbf{w})=-\langle DJ (\mathbf{u}-\rho \mathbf{w}), \mathbf{w} \rangle{.} </math> | ||

|} | |} | ||

| − | + | ||

|} | |} | ||

| Line 293: | Line 282: | ||

| style="text-align: center;" | <math>g'(\rho )=-\langle DJ (\mathbf{u}-\rho \mathbf{w}), \mathbf{w} \rangle=0. </math> | | style="text-align: center;" | <math>g'(\rho )=-\langle DJ (\mathbf{u}-\rho \mathbf{w}), \mathbf{w} \rangle=0. </math> | ||

|} | |} | ||

| − | + | ||

|} | |} | ||

| Line 305: | Line 294: | ||

| style="text-align: center;" | <math>\rho _{i+1}=\rho _{i}-\dfrac{g'(\rho _{i})}{g''(\rho _{i})}, </math> | | style="text-align: center;" | <math>\rho _{i+1}=\rho _{i}-\dfrac{g'(\rho _{i})}{g''(\rho _{i})}, </math> | ||

|} | |} | ||

| − | + | ||

|} | |} | ||

| − | aún nos falta encontrar una expresión para <math display="inline">g''(\rho )</math>. Como estamos trabajando en <math display="inline">(L^2(0,T))^3</math>, los pares de dualidad coinciden con el producto interno gracias al teorema de representación de Riesz. Dado que ya conocemos el representante de la transformación <math display="inline">DJ(v)</math> (ver ([[#eq- | + | aún nos falta encontrar una expresión para <math display="inline">g''(\rho )</math>. Como estamos trabajando en <math display="inline">(L^2(0,T))^3</math>, los pares de dualidad coinciden con el producto interno gracias al teorema de representación de Riesz. Dado que ya conocemos el representante de la transformación <math display="inline">DJ(v)</math> (ver ([[#eq-5|5]])), podemos escribir |

| − | <span id="eq- | + | <span id="eq-9"></span> |

{| class="formulaSCP" style="width: 100%; text-align: left;" | {| class="formulaSCP" style="width: 100%; text-align: left;" | ||

|- | |- | ||

| Line 318: | Line 307: | ||

| style="text-align: center;" | <math>g'(\rho )=-(\eta (\mathbf{u}-\rho \mathbf{w})+\mathbf{p}, \mathbf{w})=-\int _{0}^{T}(\eta (\mathbf{u}-\rho \mathbf{w})+\mathbf{p})\cdot \mathbf{w} \hbox{ dt}, </math> | | style="text-align: center;" | <math>g'(\rho )=-(\eta (\mathbf{u}-\rho \mathbf{w})+\mathbf{p}, \mathbf{w})=-\int _{0}^{T}(\eta (\mathbf{u}-\rho \mathbf{w})+\mathbf{p})\cdot \mathbf{w} \hbox{ dt}, </math> | ||

|} | |} | ||

| − | | style="width: 5px;text-align: right;white-space: nowrap;" | ( | + | | style="width: 5px;text-align: right;white-space: nowrap;" | (9) |

|} | |} | ||

| Line 330: | Line 319: | ||

| style="text-align: center;" | <math>\left\{ \begin{array}{c}\gamma _{1}\frac{d y_{1\rho }}{dt}+\kappa _{1}( y_{1\rho }-y_{2\rho })+ \sen y_{1\rho }=i_1+u_1-\rho w_1\hbox{ en }(0,T), \\ \gamma _{2}\frac{d y_{2\rho }}{dt}+\kappa _{1}( y_{2\rho }- y_{1\rho })+\kappa _{2}( y_{2\rho }- y_{3\rho })+\sen y_{2\rho }=i_2+ u_2-\rho w_2 \hbox{ en }(0,T), \\ \gamma _{3}\frac{d y_{3\rho }}{dt}+\kappa _{2}( y_{3\rho }- y_{2\rho })+ \sen y_{3\rho }=i_3+u_3-\rho w_3\hbox{ en }(0,T), \\ \mathbf{y}(0)=\mathbf{y}_0.\end{array}\right. </math> | | style="text-align: center;" | <math>\left\{ \begin{array}{c}\gamma _{1}\frac{d y_{1\rho }}{dt}+\kappa _{1}( y_{1\rho }-y_{2\rho })+ \sen y_{1\rho }=i_1+u_1-\rho w_1\hbox{ en }(0,T), \\ \gamma _{2}\frac{d y_{2\rho }}{dt}+\kappa _{1}( y_{2\rho }- y_{1\rho })+\kappa _{2}( y_{2\rho }- y_{3\rho })+\sen y_{2\rho }=i_2+ u_2-\rho w_2 \hbox{ en }(0,T), \\ \gamma _{3}\frac{d y_{3\rho }}{dt}+\kappa _{2}( y_{3\rho }- y_{2\rho })+ \sen y_{3\rho }=i_3+u_3-\rho w_3\hbox{ en }(0,T), \\ \mathbf{y}(0)=\mathbf{y}_0.\end{array}\right. </math> | ||

|} | |} | ||

| − | + | ||

|} | |} | ||

| Line 342: | Line 331: | ||

| style="text-align: center;" | <math>\left\lbrace \begin{array}{c}-\Gamma \dfrac{d\mathbf{p}_{\rho }}{dt}+K\mathbf{p}_{\rho }+ \left( \begin{array}{ccc}\cos y_{1 \rho } & 0 & 0 \\ 0 & \cos y_{2 \rho } & 0 \\ 0 & 0 & \cos y_{3 \rho } \\ \end{array} \right)\mathbf{p}_{\rho } =0 \hbox{ en } (0,T), \\ \Gamma \mathbf{p}_{\rho }(T)=k(\mathbf{y}_{\rho }(T)-\mathbf{y}_{T}). \end{array} \right. </math> | | style="text-align: center;" | <math>\left\lbrace \begin{array}{c}-\Gamma \dfrac{d\mathbf{p}_{\rho }}{dt}+K\mathbf{p}_{\rho }+ \left( \begin{array}{ccc}\cos y_{1 \rho } & 0 & 0 \\ 0 & \cos y_{2 \rho } & 0 \\ 0 & 0 & \cos y_{3 \rho } \\ \end{array} \right)\mathbf{p}_{\rho } =0 \hbox{ en } (0,T), \\ \Gamma \mathbf{p}_{\rho }(T)=k(\mathbf{y}_{\rho }(T)-\mathbf{y}_{T}). \end{array} \right. </math> | ||

|} | |} | ||

| − | + | ||

|} | |} | ||

| − | Para calcular <math display="inline">g''(\rho )=\dfrac{dg'}{d\rho }</math>, por la regla de Leibniz para la diferenciación bajo el signo integral tenemos, a partir de ([[#eq- | + | Para calcular <math display="inline">g''(\rho )=\dfrac{dg'}{d\rho }</math>, por la regla de Leibniz para la diferenciación bajo el signo integral tenemos, a partir de ([[#eq-9|9]]) que: |

{| class="formulaSCP" style="width: 100%; text-align: left;" | {| class="formulaSCP" style="width: 100%; text-align: left;" | ||

| Line 354: | Line 343: | ||

| style="text-align: center;" | <math>\frac{dg'(\rho )}{d\rho }=-\int _{0}^{T} \dfrac{\partial }{\partial \rho } (\eta (\mathbf{u}-\rho \mathbf{w})+\mathbf{p})\cdot \mathbf{w} \hbox{ dt }, </math> | | style="text-align: center;" | <math>\frac{dg'(\rho )}{d\rho }=-\int _{0}^{T} \dfrac{\partial }{\partial \rho } (\eta (\mathbf{u}-\rho \mathbf{w})+\mathbf{p})\cdot \mathbf{w} \hbox{ dt }, </math> | ||

|} | |} | ||

| − | + | ||

|} | |} | ||

lo cual nos da | lo cual nos da | ||

| − | + | ||

{| class="formulaSCP" style="width: 100%; text-align: left;" | {| class="formulaSCP" style="width: 100%; text-align: left;" | ||

|- | |- | ||

| Line 367: | Line 356: | ||

| style="text-align: center;" | <math>g''(\rho )=\int _{0}^{T} \left[\eta \mathbf{w}-\dot{\mathbf{p}}_{\rho } \right]\cdot \mathbf{w}\hbox{ dt }, </math> | | style="text-align: center;" | <math>g''(\rho )=\int _{0}^{T} \left[\eta \mathbf{w}-\dot{\mathbf{p}}_{\rho } \right]\cdot \mathbf{w}\hbox{ dt }, </math> | ||

|} | |} | ||

| − | + | ||

|} | |} | ||

| Line 379: | Line 368: | ||

| style="text-align: center;" | <math>g''(\rho )=\langle D^{2}J (\mathbf{u}-\rho \mathbf{w})\mathbf{w}, \mathbf{w} \rangle </math> | | style="text-align: center;" | <math>g''(\rho )=\langle D^{2}J (\mathbf{u}-\rho \mathbf{w})\mathbf{w}, \mathbf{w} \rangle </math> | ||

|} | |} | ||

| − | + | ||

|} | |} | ||

y donde <math display="inline"> \dot{\mathbf{p}}_{\rho }</math> se obtiene resolviendo | y donde <math display="inline"> \dot{\mathbf{p}}_{\rho }</math> se obtiene resolviendo | ||

| − | |||

{| class="formulaSCP" style="width: 100%; text-align: left;" | {| class="formulaSCP" style="width: 100%; text-align: left;" | ||

|- | |- | ||

| Line 392: | Line 380: | ||

| style="text-align: center;" | <math>\left\lbrace \begin{array}{c}\Gamma \dfrac{d\dot{\mathbf{y}}_{\rho }}{dt}+K\dot{\mathbf{y}}_{\rho }+ \left( \begin{array}{ccc}\cos y_{1 \rho } & 0 & 0 \\ 0 & \cos y_{2 \rho } & 0 \\ 0 & 0 & \cos y_{3 \rho } \\ \end{array} \right)\dot{\mathbf{y}}_{\rho }= \left( \begin{array}{ccc}-w_1 \\ -w_2 \\ -w_3 \\ \end{array} \right) \hbox{ en } (0,T), \\ \dot{\mathbf{y}}_{\rho }(0)=0 \end{array} \right. </math> | | style="text-align: center;" | <math>\left\lbrace \begin{array}{c}\Gamma \dfrac{d\dot{\mathbf{y}}_{\rho }}{dt}+K\dot{\mathbf{y}}_{\rho }+ \left( \begin{array}{ccc}\cos y_{1 \rho } & 0 & 0 \\ 0 & \cos y_{2 \rho } & 0 \\ 0 & 0 & \cos y_{3 \rho } \\ \end{array} \right)\dot{\mathbf{y}}_{\rho }= \left( \begin{array}{ccc}-w_1 \\ -w_2 \\ -w_3 \\ \end{array} \right) \hbox{ en } (0,T), \\ \dot{\mathbf{y}}_{\rho }(0)=0 \end{array} \right. </math> | ||

|} | |} | ||

| − | + | ||

|} | |} | ||

y luego el problema | y luego el problema | ||

| − | |||

{| class="formulaSCP" style="width: 100%; text-align: left;" | {| class="formulaSCP" style="width: 100%; text-align: left;" | ||

|- | |- | ||

| Line 405: | Line 392: | ||

| style="text-align: center;" | <math>\left\lbrace \begin{array}{c}-\Gamma \dfrac{d\dot{\mathbf{p}}_{\rho }}{dt}+K\dot{\mathbf{p}}_{\rho }+ \left( \begin{array}{ccc}\cos y_{1 \rho } & 0 & 0 \\ 0 & \cos y_{2 \rho } & 0 \\ 0 & 0 & \cos y_{3 \rho } \\ \end{array} \right)\dot{\mathbf{p}}_{\rho }= \\ \left( \begin{array}{ccc}\sen y_{1 \rho } \; \dot{y}_{1 \rho } & 0 & 0 \\ 0 & \sen y_{2 \rho } \; \dot{y}_{2 \rho } & 0 \\ 0 & 0 & \sen y_{3 \rho } \; \dot{y}_{3 \rho } \\ \end{array} \right)\mathbf{p}_{\rho } \hbox{ en } (0,T), \\ \Gamma \dot{\mathbf{p}}_{\rho }(T)=k\dot{\mathbf{y}}_{\rho }(T). \end{array} \right. </math> | | style="text-align: center;" | <math>\left\lbrace \begin{array}{c}-\Gamma \dfrac{d\dot{\mathbf{p}}_{\rho }}{dt}+K\dot{\mathbf{p}}_{\rho }+ \left( \begin{array}{ccc}\cos y_{1 \rho } & 0 & 0 \\ 0 & \cos y_{2 \rho } & 0 \\ 0 & 0 & \cos y_{3 \rho } \\ \end{array} \right)\dot{\mathbf{p}}_{\rho }= \\ \left( \begin{array}{ccc}\sen y_{1 \rho } \; \dot{y}_{1 \rho } & 0 & 0 \\ 0 & \sen y_{2 \rho } \; \dot{y}_{2 \rho } & 0 \\ 0 & 0 & \sen y_{3 \rho } \; \dot{y}_{3 \rho } \\ \end{array} \right)\mathbf{p}_{\rho } \hbox{ en } (0,T), \\ \Gamma \dot{\mathbf{p}}_{\rho }(T)=k\dot{\mathbf{y}}_{\rho }(T). \end{array} \right. </math> | ||

|} | |} | ||

| − | + | ||

|} | |} | ||

Con ésto el método de Newton para aproximar <math display="inline">\rho ^{*}</math> queda | Con ésto el método de Newton para aproximar <math display="inline">\rho ^{*}</math> queda | ||

| − | + | ||

| − | + | ||

{| class="formulaSCP" style="width: 100%; text-align: left;" | {| class="formulaSCP" style="width: 100%; text-align: left;" | ||

|- | |- | ||

| Line 418: | Line 404: | ||

|- | |- | ||

| style="text-align: center;" | <math>\rho _{i+1}=\rho _{i}-\dfrac{g'(\rho _{i})}{g''(\rho _{i})} </math> | | style="text-align: center;" | <math>\rho _{i+1}=\rho _{i}-\dfrac{g'(\rho _{i})}{g''(\rho _{i})} </math> | ||

| − | + | ||

|- | |- | ||

| style="text-align: center;" | <math> \rho _{i+1}=\rho _{i}-\dfrac{-\langle DJ (\mathbf{u}-\rho \mathbf{w}), \mathbf{w} \rangle }{\langle D^{2}J (\mathbf{u}-\rho \mathbf{w})\mathbf{w}, \mathbf{w} \rangle }</math> | | style="text-align: center;" | <math> \rho _{i+1}=\rho _{i}-\dfrac{-\langle DJ (\mathbf{u}-\rho \mathbf{w}), \mathbf{w} \rangle }{\langle D^{2}J (\mathbf{u}-\rho \mathbf{w})\mathbf{w}, \mathbf{w} \rangle }</math> | ||

| Line 426: | Line 412: | ||

|} | |} | ||

| − | + | =4 Discretización del problema de búsqueda en línea= | |

La idea principal es sustituir el espacio <math display="inline">L^2(0,T)</math> por un espacio de funciones más práctico. A grandes rasgos este espacio será el de las funciones lineales por pedazos en (0,T), que además ofrecen la ventaja de poder ser representadas computacionalmente por eneadas de números. | La idea principal es sustituir el espacio <math display="inline">L^2(0,T)</math> por un espacio de funciones más práctico. A grandes rasgos este espacio será el de las funciones lineales por pedazos en (0,T), que además ofrecen la ventaja de poder ser representadas computacionalmente por eneadas de números. | ||

| Line 518: | Line 504: | ||

en la partición <math display="inline">tt</math>. En lo que sigue detallamos cómo hacemos todas estas discretizaciones. | en la partición <math display="inline">tt</math>. En lo que sigue detallamos cómo hacemos todas estas discretizaciones. | ||

| − | + | ==4.1 Discretización del Funcional== | |

| − | El funcional <math display="inline">J</math> de ([[#eq- | + | El funcional <math display="inline">J</math> de ([[#eq-3|3]]) lo aproximamos por |

| − | |||

{| class="formulaSCP" style="width: 100%; text-align: left;" | {| class="formulaSCP" style="width: 100%; text-align: left;" | ||

|- | |- | ||

| Line 530: | Line 515: | ||

| style="text-align: center;" | <math>J^{h}(\mathbf{v})=\frac{\eta h}{2}\sum _{n=1}^{N} ||\mathbf{v}^n ||^{2}+\frac{k}{2}||\mathbf{y}^N-\mathbf{y}_T||^{2}, </math> | | style="text-align: center;" | <math>J^{h}(\mathbf{v})=\frac{\eta h}{2}\sum _{n=1}^{N} ||\mathbf{v}^n ||^{2}+\frac{k}{2}||\mathbf{y}^N-\mathbf{y}_T||^{2}, </math> | ||

|} | |} | ||

| − | + | ||

|} | |} | ||

con <math display="inline">|| \mathbf{v}^{n} ||^{2}=| v_{1}^{n} |^{2}+| v_{2}^{n} |^{2}+| v_{3}^{n}|^{2}</math>. Aquí <math display="inline">\mathbf{y}^N</math> es la aproximación de <math display="inline">\mathbf{y}</math> en el tiempo <math display="inline">N</math> <math display="inline">(tt_N=Nh)</math>, que mas adelante especificamos cómo calcular. | con <math display="inline">|| \mathbf{v}^{n} ||^{2}=| v_{1}^{n} |^{2}+| v_{2}^{n} |^{2}+| v_{3}^{n}|^{2}</math>. Aquí <math display="inline">\mathbf{y}^N</math> es la aproximación de <math display="inline">\mathbf{y}</math> en el tiempo <math display="inline">N</math> <math display="inline">(tt_N=Nh)</math>, que mas adelante especificamos cómo calcular. | ||

| − | + | ==4.2 Discretización del SEDO== | |

| − | Aproximamos el sistema ([[#eq- | + | Aproximamos el sistema ([[#eq-6|6]]) por un esquema de Euler explícito que luce como sigue: |

{| class="formulaSCP" style="width: 100%; text-align: left;" | {| class="formulaSCP" style="width: 100%; text-align: left;" | ||

| Line 548: | Line 533: | ||

|} | |} | ||

| − | + | ==4.3 Discretización del SEDO Adjunto== | |

| − | El sistema adjunto ([[#eq- | + | El sistema adjunto ([[#eq-7|7]]) lo aproximamos por |

{| class="formulaSCP" style="width: 100%; text-align: left;" | {| class="formulaSCP" style="width: 100%; text-align: left;" | ||

| Line 561: | Line 546: | ||

|} | |} | ||

| − | + | ==4.4 Discretización del Producto interno== | |

Las discretizaciones mencionadas implican que estamos considerando el siguiente producto interno | Las discretizaciones mencionadas implican que estamos considerando el siguiente producto interno | ||

| Line 574: | Line 559: | ||

|} | |} | ||

| − | + | ==4.5 <span id='lb-5.5'></span>Discretización de g'(ρ) y g''(ρ)== | |

Para resolver la ecuación <math display="inline">g(\rho ^*)=0</math> con el método de Newton se requiere el conocimiento de <math display="inline">g'(\rho )</math> que estará dada en los nuevos espacios vectoriales por | Para resolver la ecuación <math display="inline">g(\rho ^*)=0</math> con el método de Newton se requiere el conocimiento de <math display="inline">g'(\rho )</math> que estará dada en los nuevos espacios vectoriales por | ||

| − | + | ||

{| class="formulaSCP" style="width: 100%; text-align: left;" | {| class="formulaSCP" style="width: 100%; text-align: left;" | ||

|- | |- | ||

| Line 586: | Line 571: | ||

| style="text-align: center;" | <math>g'(\rho )=-h \eta \sum _{n=1}^{N}[\mathbf{u}^{n}-\rho \mathbf{w}^{n}+\mathbf{p}_{\rho }^{ n}]\cdot \mathbf{w}^{n}, </math> | | style="text-align: center;" | <math>g'(\rho )=-h \eta \sum _{n=1}^{N}[\mathbf{u}^{n}-\rho \mathbf{w}^{n}+\mathbf{p}_{\rho }^{ n}]\cdot \mathbf{w}^{n}, </math> | ||

|} | |} | ||

| − | + | ||

|} | |} | ||

| Line 613: | Line 598: | ||

y para | y para | ||

| − | |||

{| class="formulaSCP" style="width: 100%; text-align: left;" | {| class="formulaSCP" style="width: 100%; text-align: left;" | ||

|- | |- | ||

| Line 621: | Line 605: | ||

| style="text-align: center;" | <math>g''(\rho )=h\sum _{n=1}^{N}[\eta \mathbf{w}^{n}-\overset{\cdot }{\mathbf{p}}_{\rho }^{n}] \cdot \mathbf{w}^{n}, </math> | | style="text-align: center;" | <math>g''(\rho )=h\sum _{n=1}^{N}[\eta \mathbf{w}^{n}-\overset{\cdot }{\mathbf{p}}_{\rho }^{n}] \cdot \mathbf{w}^{n}, </math> | ||

|} | |} | ||

| − | + | ||

|} | |} | ||

con <math display="inline">\overset{\cdot }{\mathbf{p}}_{\rho }^{n},</math> obtenido al resolver | con <math display="inline">\overset{\cdot }{\mathbf{p}}_{\rho }^{n},</math> obtenido al resolver | ||

| − | |||

{| class="formulaSCP" style="width: 100%; text-align: left;" | {| class="formulaSCP" style="width: 100%; text-align: left;" | ||

|- | |- | ||

| Line 634: | Line 617: | ||

| style="text-align: center;" | <math>\left\{ \begin{array}{c}\overset{\cdot }{\mathbf{y}}_{\rho }^{0}=\mathbf{0}, \\ \hbox{para } n=0,....,N-1 \hbox{ resolver} \\ \overset{\cdot }{\mathbf{y}}_{\rho }^{n+1}=\overset{\cdot }{\mathbf{y}^{n}}_{\rho }-h \Gamma ^{-1} K \overset{\cdot }{\mathbf{y}}_{\rho }{ n}-h\Gamma ^{-1}\left( \begin{array}{c}\cos y_{1\rho }^{n} \\ \cos y_{2\rho }^{n} \\ \cos y_{3\rho }^{n}\end{array}\right)\overset{\cdot }{\mathbf{y}^{n}}_{\rho }-h\Gamma ^{-1}\left( \begin{array}{c}w_{1}^{n} \\ w_{2}^{n}\\ w_{3}^{n}\end{array}\right),\end{array}\right. </math> | | style="text-align: center;" | <math>\left\{ \begin{array}{c}\overset{\cdot }{\mathbf{y}}_{\rho }^{0}=\mathbf{0}, \\ \hbox{para } n=0,....,N-1 \hbox{ resolver} \\ \overset{\cdot }{\mathbf{y}}_{\rho }^{n+1}=\overset{\cdot }{\mathbf{y}^{n}}_{\rho }-h \Gamma ^{-1} K \overset{\cdot }{\mathbf{y}}_{\rho }{ n}-h\Gamma ^{-1}\left( \begin{array}{c}\cos y_{1\rho }^{n} \\ \cos y_{2\rho }^{n} \\ \cos y_{3\rho }^{n}\end{array}\right)\overset{\cdot }{\mathbf{y}^{n}}_{\rho }-h\Gamma ^{-1}\left( \begin{array}{c}w_{1}^{n} \\ w_{2}^{n}\\ w_{3}^{n}\end{array}\right),\end{array}\right. </math> | ||

|} | |} | ||

| − | + | ||

|} | |} | ||

y luego resolver | y luego resolver | ||

| − | |||

{| class="formulaSCP" style="width: 100%; text-align: left;" | {| class="formulaSCP" style="width: 100%; text-align: left;" | ||

|- | |- | ||

| Line 647: | Line 629: | ||

| style="text-align: center;" | <math>\left\{ \begin{array}{c}\overset{\cdot }{\mathbf{p}}_{\rho }^{N}=k\Gamma ^{-1}\overset{\cdot }{\mathbf{y}}_{\rho }^{N}, \\ \hbox{para }n=N-1,....,0 \hbox{ resolver} \\ \overset{\cdot }{\mathbf{p}}_{\rho }^{n}=\overset{\cdot }{\mathbf{p}}_{\rho }^{n+1}+h \Gamma ^{-1} K \overset{\cdot }{\mathbf{p}}_{\rho }^{n+1} \\ \\ +h \Gamma ^{-1} \left( \begin{array}{ccc}\cos y_{1\rho }^{n}& 0 & 0 \\ 0 & \cos y_{2\rho }^{n} & 0 \\ 0 & 0 & \cos y_{3\rho }^{n}\end{array}\right)\overset{\cdot }{\mathbf{p}}_{\rho }^{n+1} \\ \\ -\left( \begin{array}{ccc}\overset{\cdot }{y}_{1\rho }^{n}\sen y_{1\rho }^{n} & 0 & 0 \\ 0 & \overset{\cdot }{y}_{2\rho }^{n}\sen y_{2\rho }^{n} & 0 \\ 0 & 0 & \overset{\cdot }{y}_{3\rho }^{n}\sen y_{3\rho }^{n}\end{array}\right)\mathbf{p}_{\rho }^{n+1}\mathbf{.}\end{array}\right. </math> | | style="text-align: center;" | <math>\left\{ \begin{array}{c}\overset{\cdot }{\mathbf{p}}_{\rho }^{N}=k\Gamma ^{-1}\overset{\cdot }{\mathbf{y}}_{\rho }^{N}, \\ \hbox{para }n=N-1,....,0 \hbox{ resolver} \\ \overset{\cdot }{\mathbf{p}}_{\rho }^{n}=\overset{\cdot }{\mathbf{p}}_{\rho }^{n+1}+h \Gamma ^{-1} K \overset{\cdot }{\mathbf{p}}_{\rho }^{n+1} \\ \\ +h \Gamma ^{-1} \left( \begin{array}{ccc}\cos y_{1\rho }^{n}& 0 & 0 \\ 0 & \cos y_{2\rho }^{n} & 0 \\ 0 & 0 & \cos y_{3\rho }^{n}\end{array}\right)\overset{\cdot }{\mathbf{p}}_{\rho }^{n+1} \\ \\ -\left( \begin{array}{ccc}\overset{\cdot }{y}_{1\rho }^{n}\sen y_{1\rho }^{n} & 0 & 0 \\ 0 & \overset{\cdot }{y}_{2\rho }^{n}\sen y_{2\rho }^{n} & 0 \\ 0 & 0 & \overset{\cdot }{y}_{3\rho }^{n}\sen y_{3\rho }^{n}\end{array}\right)\mathbf{p}_{\rho }^{n+1}\mathbf{.}\end{array}\right. </math> | ||

|} | |} | ||

| − | + | ||

|} | |} | ||

Con esto podemos ya aplicar el método de Newton para resolver la versión discreta de <math display="inline">g'(\rho )=0</math>: Dado <math display="inline">\rho ^{0}</math>, iterar con | Con esto podemos ya aplicar el método de Newton para resolver la versión discreta de <math display="inline">g'(\rho )=0</math>: Dado <math display="inline">\rho ^{0}</math>, iterar con | ||

| − | |||

{| class="formulaSCP" style="width: 100%; text-align: left;" | {| class="formulaSCP" style="width: 100%; text-align: left;" | ||

|- | |- | ||

| Line 660: | Line 641: | ||

| style="text-align: center;" | <math>\rho ^{m+1}=\rho ^{m}-\frac{g'(\rho ^{m})}{g''(\rho ^{m})}. </math> | | style="text-align: center;" | <math>\rho ^{m+1}=\rho ^{m}-\frac{g'(\rho ^{m})}{g''(\rho ^{m})}. </math> | ||

|} | |} | ||

| − | + | ||

|} | |} | ||

Usamos el criterio de paro <math display="inline">\dfrac{\vert \rho ^{m+1}-\rho ^{m}\vert }{\vert \rho ^{m+1}\vert }< \varepsilon </math>, para <math display="inline">\varepsilon </math> pequeño dado. | Usamos el criterio de paro <math display="inline">\dfrac{\vert \rho ^{m+1}-\rho ^{m}\vert }{\vert \rho ^{m+1}\vert }< \varepsilon </math>, para <math display="inline">\varepsilon </math> pequeño dado. | ||

| − | + | =5 Experimentación computacional= | |

| − | + | ==5.1 Ejemplo 1== | |

En este ejemplo tomamos <math display="inline">u_1(t)=t \exp (-t)</math>, <math display="inline">u_2(t)=t^3</math>, <math display="inline">u_3(t)=0</math> y <math display="inline">w_1(t)=\exp (-t)/10</math>, <math display="inline">w_2(t)=3t-t^3</math> y <math display="inline">w_3(t)=0</math>. Se tomaron los valores siguientes para los parámetros en la iteración de Newton y en la discretización de los problemas involucrados: | En este ejemplo tomamos <math display="inline">u_1(t)=t \exp (-t)</math>, <math display="inline">u_2(t)=t^3</math>, <math display="inline">u_3(t)=0</math> y <math display="inline">w_1(t)=\exp (-t)/10</math>, <math display="inline">w_2(t)=3t-t^3</math> y <math display="inline">w_3(t)=0</math>. Se tomaron los valores siguientes para los parámetros en la iteración de Newton y en la discretización de los problemas involucrados: | ||

| Line 684: | Line 665: | ||

|} | |} | ||

| − | + | ==5.2 Ejemplo 2== | |

En este ejemplo tomamos <math display="inline">u_1(t)=-(t-2)\exp (-t)</math>, <math display="inline">u_2(t)=3t^2+1</math>, <math display="inline">u_3(t)=(t-1)^2+1</math> y <math display="inline">w_1(t)=t^3+t-1</math>, <math display="inline">w_2(t)=\dfrac{1}{3}t^3-t</math>, <math display="inline">w_3(t)=\exp (-t)/10</math>. Tanto para la discretización de los problemas involucrados como para las iteraciones de Newton se tomaron los valores siguientes: | En este ejemplo tomamos <math display="inline">u_1(t)=-(t-2)\exp (-t)</math>, <math display="inline">u_2(t)=3t^2+1</math>, <math display="inline">u_3(t)=(t-1)^2+1</math> y <math display="inline">w_1(t)=t^3+t-1</math>, <math display="inline">w_2(t)=\dfrac{1}{3}t^3-t</math>, <math display="inline">w_3(t)=\exp (-t)/10</math>. Tanto para la discretización de los problemas involucrados como para las iteraciones de Newton se tomaron los valores siguientes: | ||

| Line 701: | Line 682: | ||

|} | |} | ||

| − | + | =6 Conclusiones= | |

No contamos con un ejemplo para el cual se conozca la solución exacta, así que nuestra validación se basa en el desempeño del método en ejemplos como los dos mostrados, dado que es posible tener una visualización suficientemente detallada del funcional <math display="inline">J</math> restringido a la "recta" que pasa por <math display="inline">\mathbf{u}</math> y tiene dirección <math display="inline">\mathbf{w}</math>. De acuerdo a estos ejemplos se puede concluir que el método de Newton produce resultados excelentes. En este trabajo el objetivo no es comparar el método de Newton con otros métodos, sino verificar que este tipo de problemas se pueden resolver aceptablemente utilizando el método de Newton; sin embargo en trabajos futuros esperamos considerar otros métodos y hacer tal comparación, por ejemplo, con los métodos que no utilizan derivadas. También podemos mencionar que los resultados presentados aquí se aplicarán próximamente para resolver el problema de minimización global asociado con el problema de control, el cual, como se conocen el estado inicial del que se parte y el estado final al que se quiere llegar, podrá considerarse como un caso de validación de la metodología expuesta en el presente trabajo. | No contamos con un ejemplo para el cual se conozca la solución exacta, así que nuestra validación se basa en el desempeño del método en ejemplos como los dos mostrados, dado que es posible tener una visualización suficientemente detallada del funcional <math display="inline">J</math> restringido a la "recta" que pasa por <math display="inline">\mathbf{u}</math> y tiene dirección <math display="inline">\mathbf{w}</math>. De acuerdo a estos ejemplos se puede concluir que el método de Newton produce resultados excelentes. En este trabajo el objetivo no es comparar el método de Newton con otros métodos, sino verificar que este tipo de problemas se pueden resolver aceptablemente utilizando el método de Newton; sin embargo en trabajos futuros esperamos considerar otros métodos y hacer tal comparación, por ejemplo, con los métodos que no utilizan derivadas. También podemos mencionar que los resultados presentados aquí se aplicarán próximamente para resolver el problema de minimización global asociado con el problema de control, el cual, como se conocen el estado inicial del que se parte y el estado final al que se quiere llegar, podrá considerarse como un caso de validación de la metodología expuesta en el presente trabajo. | ||

| − | + | ==BIBLIOGRAFÍA== | |

<div id="cite-1"></div> | <div id="cite-1"></div> | ||

Latest revision as of 05:14, 19 December 2021

1 Introducción

En optimización, la estrategia de búsqueda en línea es uno de los enfoques iterativos básicos para encontrar un mínimo local de una función objetivo . El enfoque de búsqueda en línea primero supone conocida una aproximación previa para y encuentra una dirección de descenso a lo largo de la cual la función objetivo será minimizada y entonces esto determinará qué tan lejos debe moverse a lo largo de esa dirección. Este tamaño de paso está asociado con un mínimo local de la restricción de a la recta de búsqueda. Al problema de encontrar este tamaño de paso se le llama un problema de búsqueda en línea, es decir, es un problema de minimización con restricciones de la forma

|

|

que también se puede escribir como

|

|

(1) |

Aquí la recta de búsqueda es la recta que pasa por y tiene (por conveniencia, para nuestras posteriores aplicaciones) la dirección . Como ya se dijo, una de las áreas donde surgen problemas de búsqueda en línea son los métodos iterativos para minimizar localmente una función sin restricciones. En cada iteración debe resolverse un problema de búsqueda en línea de la forma (1), para y conocidos. Si denotamos con a la solución del problema de búsqueda en línea de la iteración , se toma a como la nueva aproximación para el mínimo de . La solución de los problemas de búsqueda en línea se puede aproximar por una variedad de métodos numéricos [1], entre ellos el método de Newton. Si definimos entonces la solución del problema (1) es equivalente a la solución del problema en

|

|

Para resolver este problema buscamos los valores donde la derivada de se hace cero, es decir, resolvemos (por el método de Newton) la ecuación

|

|

Tenemos que

|

|

donde denota la derivada direccional de en en la dirección de . Así que por comodidad definimos

|

|

y resolvemos la ecuación

|

|

para lo cual, dada una aproximación inicial , se construyen sucesivas aproximaciones de acuerdo a

|

|

En este trabajo extenderemos estas ideas para aplicar el método de Newton a un problema de búsqueda en línea pero donde los elementos y aunque conocidos, pertenecen al espacio de Hilbert y no a . En este contexto, este artículo es una continuación o extensión de lo expuesto en [2].

2 Descripción del problema

Los problemas de búsqueda en línea en que estamos interesados aquí son del tipo

|

|

(2) |

con y fijos en , y donde el funcional de nuestro interés es

|

|

(3) |

donde y la norma euclideana canónica, donde es una función vectorial, , y la función vectorial es la solución del siguiente problema de valor inicial que modela la dinámica de un circuito de tres juntas de Josephson acopladas inductivamente, [3]:

|

|

(4) |

En (3)-(4), y son estados inicial y final conocidos, respectivamente. En [3] y en [4] se dan los siguientes valores factibles para los parámetros involucrados en este sistema y con los cuales se harán los experimentos numéricos mas adelante:

|

|

2.1 El problema de minimización global y el diferencial de J

El problema de minimización global o sin restricciones asociado con los problemas de búsqueda en línea descritos es

|

|

el cual, (junto con (3)-(4)) corresponde a un problema de control cuyo objetivo es llevar la dinámica del sistema del estado al estado . Este tipo de problemas de control pueden resolverse usando un algoritmo de gradiente conjugado como los discutidos en el Capítulo 2 de [5] y el Capítulo 3 de [6], donde también se menciona el concepto de Frechet-diferenciabilidad adecuado para minimizar funcionales en espacios de Hilbert. A continuación damos una definción y un teorema básicos para resolver el problema que nos ocupa.

Definición. Sea un espacio de Hilbert. Un funcional sobre es Frechet-diferenciable si, para todo , existe , la derivada o el diferencial de en , tal que

|

|

con denotando par de dualidad, y tendiendo a cero cuando tiende a cero.

Teorema. Si está definido como en (3) entonces es Frechet-diferenciable y su diferencial es

|

|

(5) |

donde se obtiene al resolver el sistema (versión matricial de (4)) :

|

|

(6) |

y después el sistema adjunto

|

|

(7) |

donde es una matriz diagonal de 3x3 para la cual la entrada iésima de la diagonal es .

De este teorema resulta que , con solución de (7) una vez que es solución del sistema (6) tomando .

La demostración de este teorema, y de los resultados que se mencionan a continuación pueden consultarse en [7].

3 Metodología de solución

Para resolver por el método de Newton nuestro problema de búsqueda en línea (2) definimos

|

|

(8) |

entonces el problema se reduce a encontrar raíces para (un problema de en ), las cuales aproximaremos con la iteración de Newton

para lo cual debemos conocer y . Para describir en términos de necesitamos el siguiente teorema:

Teorema. Sea un funcional Frechet-diferenciable sobre y como en (8). Entonces

|

|

Así que la ecuación que tenemos que resolver para es

|

|

Como la iteración de Newton es

|

|

aún nos falta encontrar una expresión para . Como estamos trabajando en , los pares de dualidad coinciden con el producto interno gracias al teorema de representación de Riesz. Dado que ya conocemos el representante de la transformación (ver (5)), podemos escribir

|

|

(9) |

donde se obtiene resolviendo

|

|

y luego el problema

|

|

Para calcular , por la regla de Leibniz para la diferenciación bajo el signo integral tenemos, a partir de (9) que:

|

|

lo cual nos da

|

|

que denotaremos como

|

|

y donde se obtiene resolviendo

|

|

y luego el problema

|

|

Con ésto el método de Newton para aproximar queda

|

|

4 Discretización del problema de búsqueda en línea

La idea principal es sustituir el espacio por un espacio de funciones más práctico. A grandes rasgos este espacio será el de las funciones lineales por pedazos en (0,T), que además ofrecen la ventaja de poder ser representadas computacionalmente por eneadas de números.

Para describir esto con mayor precisión, comenzamos haciendo una partición uniforme del intervalo con

- número de subintervalos de la partición uniforme.

- tamaño de cada subintervalo.

- un vector de puntos espaciados uniformemente en el intervalo de la forma

|

|

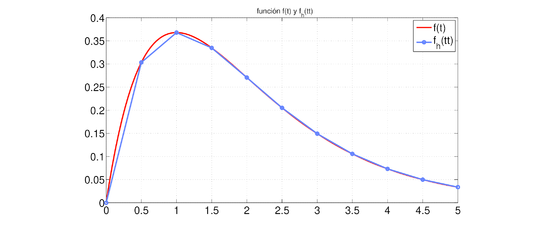

Dada esta partición, una función en puede ser aproximada por la función lineal por pedazos cuyo valor en es . En la figura 1 se muestra una y su aproximación lineal por pedazos, con . Note que entonces una función puede ser representada computacionalmente por dos -eadas:

|

|

|

| Figura 1: Función y con y . |

Con esto, está claro que podemos aproximar las funciones en por triadas de funciones lineales por pedazos, es decir por matrices de la forma

mientras que las funciones de nuestra teoría quedarían aproximada o representadas por la matriz

|

|

y las funciones de nuestra teoría quedarían aproximadas o representadas por la matriz

|

|

También a partir de ahora, estaremos usando la notación para denotar el valor de la función , lineal por pedazos, en el tiempo . Esta notación también aplica para las funciones y , es decir, con denotamos el valor de la función en el tiempo y similarmente para . Esto se resume en decir que en este capítulo damos los valores de y en la partición y debemos minimizar una version discreta del funcional, para lo cual es necesario encontrar los valores aproximados de

|

|

y de

|

|

en la partición . En lo que sigue detallamos cómo hacemos todas estas discretizaciones.

4.1 Discretización del Funcional

El funcional de (3) lo aproximamos por

|

|

con . Aquí es la aproximación de en el tiempo , que mas adelante especificamos cómo calcular.

4.2 Discretización del SEDO

Aproximamos el sistema (6) por un esquema de Euler explícito que luce como sigue:

|

|

4.3 Discretización del SEDO Adjunto

El sistema adjunto (7) lo aproximamos por

|

|

4.4 Discretización del Producto interno

Las discretizaciones mencionadas implican que estamos considerando el siguiente producto interno

|

|

4.5 Discretización de g'(ρ) y g(ρ)

Para resolver la ecuación con el método de Newton se requiere el conocimiento de que estará dada en los nuevos espacios vectoriales por

|

|

donde se obtiene resolviendo

|

|

y luego resolviendo

|

|

y para

|

|

con obtenido al resolver

|

|

y luego resolver

|

|

Con esto podemos ya aplicar el método de Newton para resolver la versión discreta de : Dado , iterar con

|

|

Usamos el criterio de paro , para pequeño dado.

5 Experimentación computacional

5.1 Ejemplo 1

En este ejemplo tomamos , , y , y . Se tomaron los valores siguientes para los parámetros en la iteración de Newton y en la discretización de los problemas involucrados:

- ; ; ; ; .

- ; .

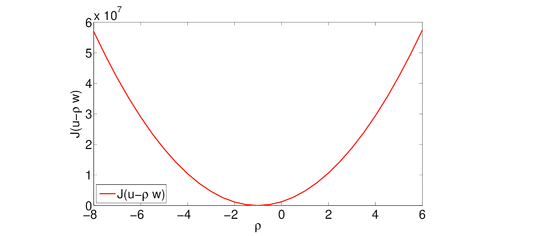

Dadas las funciones y , minimizamos con el método de Newton el funcional sobre y en 3 iteraciones se obtuvo el valor . La gráfica del funcional restringido a la recta se muestra en la Figura 2.

|

| Figura 2: Funcional para las funciones y del ejemplo 1. |

5.2 Ejemplo 2

En este ejemplo tomamos , , y , , . Tanto para la discretización de los problemas involucrados como para las iteraciones de Newton se tomaron los valores siguientes:

- ; ; ; ; .

- ; .

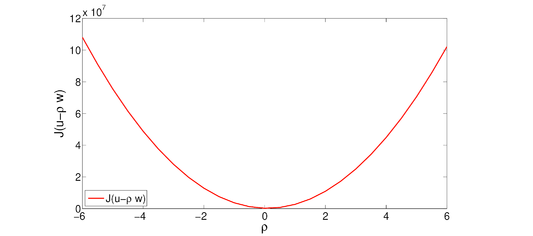

Dadas las funciones y , minimizamos con el método de Newton el funcional sobre y en 6 iteraciones se obtuvo el valor . La gráfica del funcional restringido a la recta se muestra en la Figura 3.

|

| Figura 3: Funcional para las funciones y del ejemplo 2. |

6 Conclusiones

No contamos con un ejemplo para el cual se conozca la solución exacta, así que nuestra validación se basa en el desempeño del método en ejemplos como los dos mostrados, dado que es posible tener una visualización suficientemente detallada del funcional restringido a la "recta" que pasa por y tiene dirección . De acuerdo a estos ejemplos se puede concluir que el método de Newton produce resultados excelentes. En este trabajo el objetivo no es comparar el método de Newton con otros métodos, sino verificar que este tipo de problemas se pueden resolver aceptablemente utilizando el método de Newton; sin embargo en trabajos futuros esperamos considerar otros métodos y hacer tal comparación, por ejemplo, con los métodos que no utilizan derivadas. También podemos mencionar que los resultados presentados aquí se aplicarán próximamente para resolver el problema de minimización global asociado con el problema de control, el cual, como se conocen el estado inicial del que se parte y el estado final al que se quiere llegar, podrá considerarse como un caso de validación de la metodología expuesta en el presente trabajo.

BIBLIOGRAFÍA

[1] R. P. Brent (2002) Algorithms for minimization without derivatives. New York: Courier Dover Publications.

[2] J. López, L. H. Juárez (2019) Método de Newton para Problemas de Búsqueda en Línea en . Journal of Basic Sciences. Vol. 5, Num. 13.

[3] Y. Braiman, B. Neschke, N. Nair, N. Ima, and R. Glowinski. (2016) Memory States in Small Arrays of Josephson Junctions, PHYSICAL REVIEW E (94), 052223: 1-13.

[4] J. D. Rezac, N. Imam and Y. Braiman, (2017) Parameter optimization for transitions between memory states in small arrays of Josephson junctions, PHYSICA A (474), 267-281.

[5] R. Glowinski (2015) Variational Methods for the Numerical Solution of Nonlinear Elliptic Problems, Philadelphia: SIAM.

[6] R. Glowinski (2003) Finite element methods for incompressible viscous flow. In Handbook of Numerical Analysis, Vol. IX, P.G. Ciarlet & J.L. Lions, eds., 3-1176, Amsterdam: Elsevier.

[7] C. N. Cortazar (2020) Método de Newton para búsquedas en línea en el espacio . Tesis de Maestría. Universidad Juárez Autónoma de Tabasco.

Document information

Published on 19/04/21

Submitted on 09/03/21

Licence: CC BY-NC-SA license